No products in the cart.

Tin tức

GPT-3 mở ra cuộc chiến mới của các siêu AI

GPT-3 là gì?

GPT-3 đang mở ra cuộc chiến mới trong việc phát triển các siêu AI với mô hình, tham số và năng lực vượt trội. Đây là mô hình tạo văn bản AI được viết bởi Alec Radford sau đó được phát triển bởi OpenAI của Elon Mask.

Được ra mắt vào năm 2018, GPT được sử dụng một mô hình ngôn ngữ tổng quát bao gồm 2 hệ thần kinh cạnh tranh lẫn nhau. Chỉ dựa trên một vài dữ liệu đầu vào hạn hẹp, GPT có thể cho ra một đoạn văn bản hoàn chỉnh.

Ứng dụng vượt trội của GPT-3

GPT-3 được tung ra vào tháng 6 năm 2020 đã lập tức thu hút sự chú ý của giới truyền thông công nghệ bởi khả năng ngôn ngữ giống như con người.

Khả năng tạo ra văn bản và phản hồi trôi chảy một cách tự nhiên. Nó tiên tiến hơn những trợ lý ảo như Siri của Apple hay Alexa của Amazon vì có thể bắt chước nhiều phong cách viết chỉ với một click chuột.

Đây là một siêu AI có tầm ảnh hưởng lớn vào năm 2021. Khi các ông lớn là những tập đoàn công nghệ và phòng thí nghiệm công bố những mô hình AI có kích thước và năng lực vượt trội GPT-3.

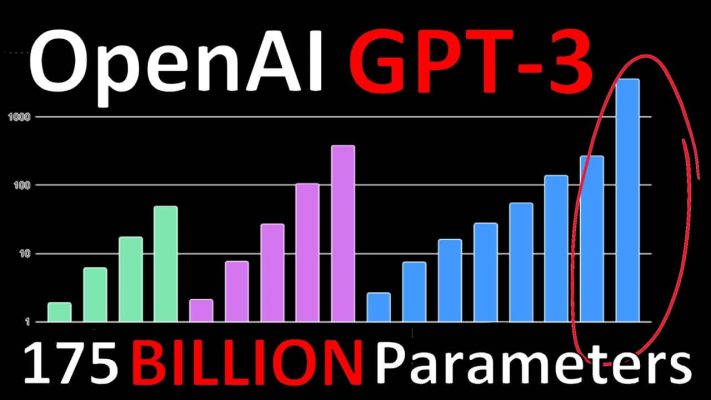

Năng lực của GPT-3 không đến từ thuật toán, mà bởi kích thước mô hình của chính nó. Kích thước mô hình đào tạo AI được đo bằng lượng tham số sở hữu. Đây là những biến số có thể điều chỉnh liên tục trong quá trình huấn luyện AI, giúp xây dựng năng lực dự đoán. AI càng nhiều tham số sẽ càng tiếp nhận được nhiều thông tin từ dữ liệu đào tạo, cho phép nó dự đoán và phản ứng chính xác hơn với những dữ liệu mới.

GPT-3 mở ra kỷ nguyên mới cho cuộc chiến siêu AI

Khi vào tháng 2/2019 GPT-2 ra mắt đạt được số tham chiếu 1,5 tỷ đã tạo ra một làn sóng trong giới công nghệ. Thì GPT-3 ra mắt vào năm 2020 đã đạt đến 175 tỷ tham chiếu đã đánh dấu một kỷ nguyên mới vượt trội cho các siêu AI. Điều này đồng nghĩa với GPT-3 thông minh hơn và có khả năng taọ ra các đoạn văn bản không khác gì con người.

Mặc dù vậy, cuộc chiến này vẫn chưa bao giờ có điểm dừng. Startup Mỹ AI21 Labs hồi tháng 9 năm ngoái công bố Jurassic-1, mô hình ngôn ngữ đã được thương mại hóa, với 178 tỷ tham số. Gopher, mô hình đào tạo được DeepMind cho ra mắt sau đó ba tháng, có 280 tỷ tham số. Còn Megatron-Turing NLG, dự án hợp tác của Microsoft và Nvidia, có 530 tỷ tham số. Google cũng tung ra Switch-Transformer và GLaM với con số lần lượt là 1.000 và 1.200 tỷ.

Xu hướng này không chỉ giới hạn tại Mỹ. Tập đoàn Huawei của Trung Quốc đã xây dựng mô hình ngôn ngữ PanGu với 200 tỷ tham số, trong khi Inspur ra mắt Yuan 1.0 có 245 tỷ tham số. Baidu và Phòng thí nghiệm Peng Cheng ở Thẩm Quyến công bố mô hình PCL-BAIDU Wenxin 280 tỷ tham số. Trong lúc đó, Học viện AI Bắc Kinh ra mắt Wu Dao 2.0 lên tới 1.750 tỷ tham số.

Những siêu AI cũng mang đến những thách thức không nhỏ cho các nhà nghiên cứu

Tất cả những sản phẩm này đều được coi là những thành tựu khoa học đáng kinh ngạc. Để xây dựng những mô hình tham số lớn này là vô cùng phức tạp, cần phải có sự đồng nhất của hàng trăm bộ xử lý đồ họa GPU – phần cứng được ưa thích để đào tạo mạng neuron sâu – cần được kết nối và đồng bộ. Dữ liệu huấn luyện cũng phải được chia nhỏ thành từng khối, phân bổ cho các GPU theo đúng thứ tự và thời điểm.

Những mô hình lớn tạo nên các siêu AI đã trở thành những mô hình danh giá, là hình ảnh phô trương của các doanh nghiệp.Tuy nhiên, còn khá nhiều vấn đề cần giới khoa học giải đáp như số lượng tham số tỷ lệ thuận với năng lực của AI. Họ cũng chưa tìm ra cách xử lý vấn đề ngôn ngữ độc hại và phát tán tin giả mà các mô hình này “học” được trong quá trình đào tạo.

Theo nhận xét của Kaplan: “Mô hình quy mô lớn sẽ trở thành điều bình thường trong 10-20 năm tới. Nếu điều đó diễn ra, giới nghiên cứu sẽ phải tập trung vào phương án tận dụng kích thước khổng lồ của mô hình, thay vì chỉ đơn giản tìm cách mở rộng nó”.

Cùng tìm hiểu thêm các ứng dụng khác trong ngành công nghiệp AI